Jeder weiß: Bilder, Videos und Audios lassen sich heute, mit geringen Kenntnissen und Aufwand, per frei verfügbarer Software leicht manipulieren. Ob nun plötzlich eine Politikerin oder ein Politiker etwas „Aufregendes“ sagt, plötzlich ein Promi in einer pornografischen Videosequenz oder einem Bild auftaucht oder in einer Whatsapp-Sprachnachricht das Kind dringend um Geld bittet, die negativen oder kriminellen Aspekte sind bekannt.

Politik, NGOS, Bürgerinnen und Bürger fordern Regulierung von, zumeist KI generierten, Deepfakes, aber wie erkennt man diese? Johannes Wobus aus Leipzig kündigte 2024 in unserem Gespräch einen Deepfake-Generator für die Erkennung dieser an und hat uns das Modell jetzt vorgestellt. Wir trafen uns mit ihm zum Gespräch. Der Autor und Johannes Wobus sind seit der OTMR 2024 per Du, wir haben das im Gespräch beibehalten.

Hallo Johannes, schön, dass es geklappt hat. Erst einmal für unsere Leserinnen und Leser, was ist Dein beruflicher Hintergrund?

Ich bin Softwareentwickler und Data Scientist, die Bezeichnung hat Peter Hense irgendwann mal eingeführt. Ich finde die neue Bezeichnung zutreffend. Ich beschäftige mich schon sehr lange mit Softwareentwicklung, der Analyse von großen Datenmengen und seit knapp vier Jahren, ziemlich in Vollzeit, mit künstlicher Intelligenz.

Künstliche Intelligenz, das war ja ein Thema in unserem letzten Gespräch. Du hast gesagt, Du willst ein Tool zur Analyse und Erkennung von Deepfakes entwickeln. Das hast Du jetzt geschafft. Was kann man damit analysieren?

Du musst Dir die Software modular vor Augen führen, die nennen wir sie mal „Suite“ kann erkennen und analysieren, ob Videos vollsynthetisch oder teilsynthetisch sind. Teilweise ist es auch möglich den Generator, mit dem diese verändert oder erstellt wurden, zu identifizieren. Ein anderes Modul ist in der Lage, Audios zu scannen, ebenfalls als vollsynthetisch oder teilsynthetisch. Seit einigen Tagen bin ich auch in der Lage, gefakte Bilder zu erkennen.

Mit vollsynthetisch oder teilsynthetisch ist mit KI verändert oder komplett KI generiert gemeint?

Genau, teilsynthetisch kannst Du Dir so vorstellen, als diese klassischen Gesichtsaustausch-Sachen, besonders in diesem unschönen Element der Deepfake-Pornografie, darüber muss man ja auch leider reden. Es gibt ja auch einige Fälle, bei denen in Zoom-Meetings mit KI ein fremder Kopf auf eine Person gesetzt wurde. Ich denke, in zwei bis drei Wochen werde ich ein Update ausrollen, dann wird nicht primär der Kopf betrachtet, sondern der Mund. Die Münder werden ja auch ausgetauscht.

Deepfakes sind ja ein großes Thema, sowohl im politischen, im wirtschaftlichen, als auch im privaten Bereich. Es gibt jede Menge frei verfügbare Programme, mit denen man Deepfakes herstellen kann. Dafür sind oft keine großen Vorkenntnisse erforderlich. Kann Dein Programm jeder bedienen oder ist das nur etwas was für Spezialisten?

Das ist eine wirklich witzige Frage. Ich hatte erst diese Woche einen sehr guten Freund zu Gast, der mich immer wieder ausschimpft. Du musst mehr machen mit der Oberflächengestaltung, ich habe davon leider keine Ahnung. Ich bin eher datengetrieben. Ich denke, dass ich demnächst ein besseres Layout, als das, was Du heute gesehen hast, freischalten werde. Aber mit relativ wenig Schulung, können das auch Laien bedienen. Also Menschen, die einen Computer bedienen können, können diese Programme auch bedienen.

Ist das Programm eher etwas für Firmen und Organisationen, oder ist das auch etwas für den privaten Nutzer?

Die Hauptzielgruppe sind natürlich Firmen, Behörden, Institutionen. Für den privaten Nutzer ist das aber auch etwas. Wir haben ja auch die, ich nenne das mal liebevoll, Seuche der Schockanrufe. Es kann schon interessant sein, wenn man ein unklares Audio-File, eine unklare Sprachnachricht über WhatsApp geschickt bekommt, gegenprüft, mit der einen Applikation, die ich Dir gezeigt habe. Also, es wäre schon was für den privaten Nutzer, aber ich bin wirklich nicht kreativ begabt genug, um daraus eine gut aussehende App zu bauen, die man auch verwenden kann. Aber da bin ich tatsächlich dran.

Also ist die Arbeit am Interface noch im Gange?

Genau, gefakte Audios, Videos und Bilder, hinsichtlich der Zielgruppe, betrifft es leider mittlerweile uns alle.

Auf technische Details wollen wir hier nicht eingehen, das würde den Rahmen sprengen. Es wird ja auch eine Art Wettbewerb. Die KI zur Generierung von Deepfakes wird immer besser. Du wirst Deine Programme natürlich auch immer wieder anpassen und updaten müssen, damit auch die nächste Generation der KI-Generierung noch erkannt wird.

Das ist richtig, beim Video Deepfake-Scanner, war das letzte Trainingsstadium Stand Anfang 2025. Seitdem hat sich unfassbar viel verändert. Die Chinesen haben ihre Modelle auf den Markt geworfen. Und ich war da sehr, sehr unsicher, unter uns gesagt, ob die Modelle etwas taugen. Alle Proben, die ich gezogen habe, mit besagten Modellen, ergaben teilweise Erkennungswahrscheinlichkeiten oder Erkennungssicherheiten in Höhe von weit über 90 Prozent.

Das hängt mit dem speziellen Trainingsverfahren zusammen. Ich gehe im Grunde auf die kleinsten Elemente der zu analysierenden Medien. Bei Videos wären das Pixel und die Pixel-Natur. Wir wollen ja nicht zu technisch werden, wie Du gesagt hast. Und bei Audios gehe ich auf Segmente, vergleichbar mit einem Frame oder einem Pixel.

Gibt es schon Interessenten dafür?

Es gibt einige Interessenten, wir führen Gespräche mit zwei relativ bekannten NGOs bzw. Vereinen. Hier im Leipziger Dunstkreis führe ich einige Gespräche mit persönlich befreundeten Lehrerinnen und Lehrern. Dann gibt es im Bereich der Behörden immer mal Anfragen, wo wir jetzt in tiefere Gespräche hereingehen. Der Videoscanner wird bereits jetzt schon verwendet, das ist richtig.

Kannst Du auch schon eine Referenz nennen oder noch nicht?

Nein, auf gar keinen Fall. Ich kann nur so viel sagen, dass im Bereich der Behörden schon etwas eingesetzt wird.

Wenn sich jemand für den Deepfake-Scanner interessiert, gibt es eine Webseite und wie kommt man an das Produkt ran?

Selbstverständlich gibt es unsere Webseite, da kann man auch schon mal testen. Für Interessenten ist es wichtig folgendes zu wissen: Wir haben gewisse interne – nennen wir es moralische, wobei das natürlich hochgegriffen ist – Standards. Es findet zuerst ein Kennenlerngespräch statt, in dem man klärt: Wo ist der Einsatz, welches Klientel wird betreut?

Uns ist sehr wichtig, gerade im Bereich des Hatespeech etwas zu machen. Wie wir beide ja wissen, diese Fakes sind zwar eine feine Sache, man kann mit KI wunderbare Kunstwerke generieren, aber man kann auch gezielt den Ruf von Menschen zerstören. Das sind tatsächlich derzeit zwei Gesprächslinien im Bereich Abwehr von Deepfake-Pornografie.

Vielen Dank für das Gespräch und die Vorführung des Scanners. Weiterhin viel Erfolg und wir werden das weiter verfolgen.

Johannes hat uns die Software selbstverständlich vorgeführt, die Ergebnisse waren eindeutig. KI-generierte Videos und Stimmen wurden erkannt. Im Beispielvideo sind zwei Tests zu sehen, diese wurden mit frei im Netz verfügbaren KI-generierten Videos durchgeführt und zeigen die Funktionsweise des Scanners.

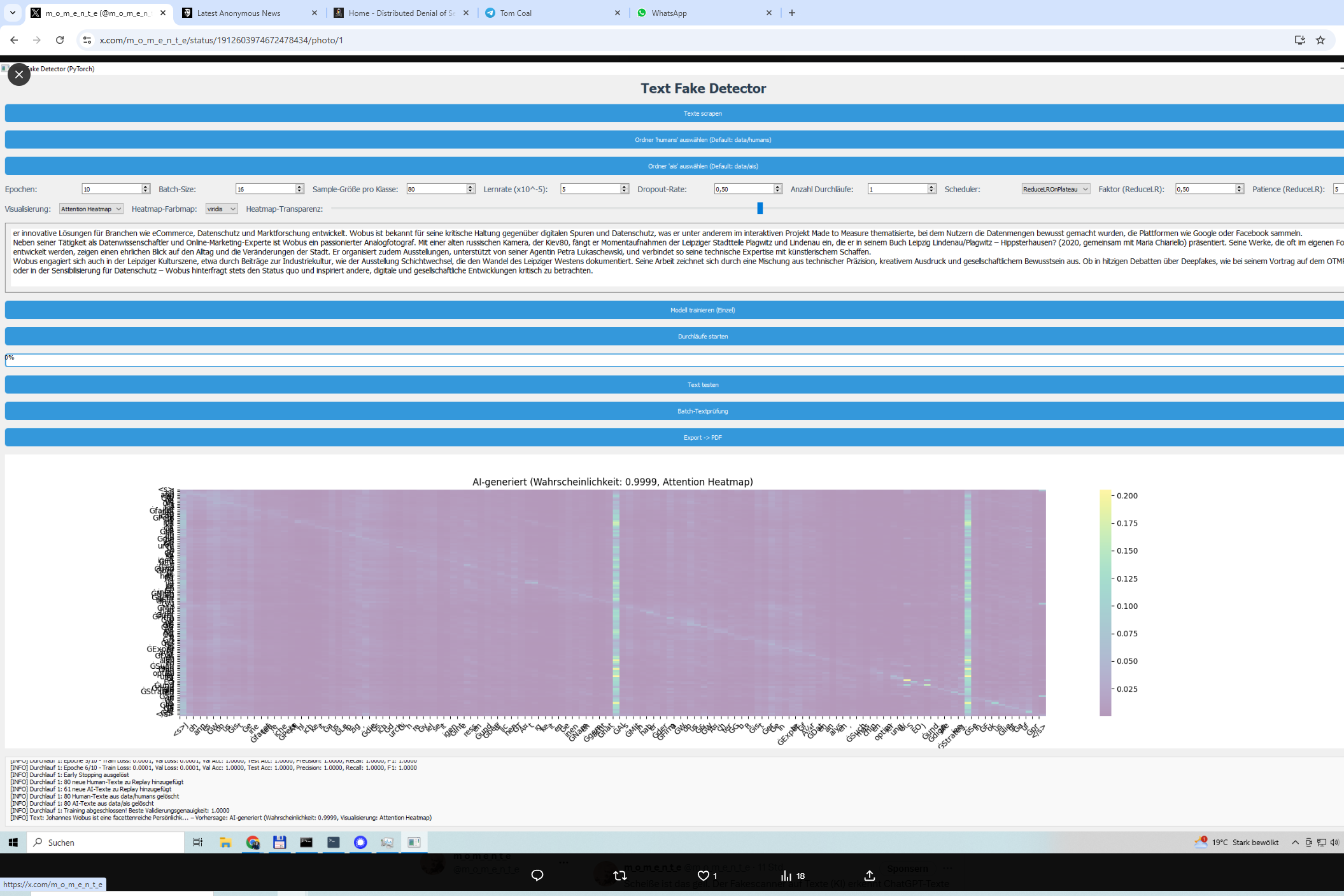

Neben der Verfeinerung der schon verfügbaren Scanner arbeitet Johannes momentan an der Erkennung von KI-generierten Texten. Erste Ergebnisse, die hoffnungsfroh stimmen, liegen vor. Wir werden berichten, wenn diese Software einsatzbereit ist.

Empfohlen auf LZ

So können Sie die Berichterstattung der Leipziger Zeitung unterstützen:

Keine Kommentare bisher